题材相关新闻:

HBM行业动态

1、英伟达发布H200 Al芯片,首次搭载HBM3E存储,与A100相比容量几乎翻倍,带宽增加2.4倍。

2、三星和SK海力士正准备将HBM产量提高至2.5倍,SK预计到2030年公司HBM出货量将达到每年1亿颗。

题材基本面介绍:

HBM 作为基于 3D 堆栈工艺的高性能DRAM,打破内存带宽及功耗瓶颈,GPU 性能提升推动 HBM 技术不断升级。

一、需求端:AI 推动 HBM 需求强劲增长

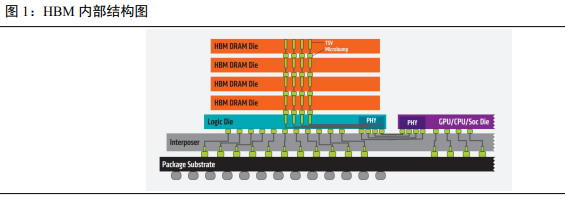

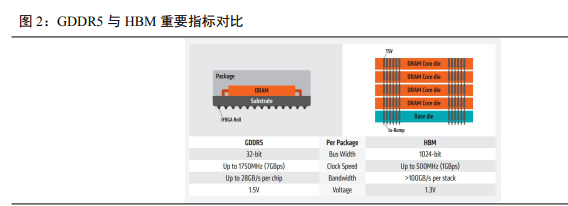

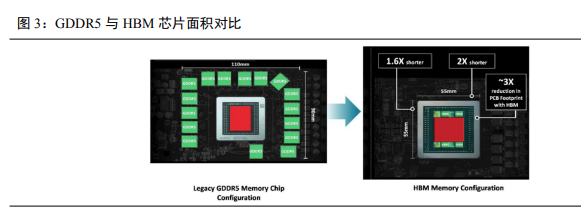

HBM作为基于3D堆栈工艺的高性能DRAM,打破内存带宽及功耗瓶颈。HBM(High BandwidthMemory)即高带宽存储器,通过使用先进封装(如 TSV 硅通孔、微凸块)将多个 DRAM芯片进行堆叠,并与GPU一同进行封装,形成大容量、高带宽的 DDR 组合阵列。

HBM 通过与处理器相同的“Interposer”中间介质层与计算芯片实现紧凑连接,一方面既节省了芯片面积,另一方面又显著减少了数据传输时间;此外HBM采用 TSV 工艺进行 3D 堆叠,不仅显著提升了带宽,同时降低了功耗,实现了更高的集成度。HBM 性能远超 GDDR,成为当前 GPU 存储单元理想解决方案。

二、供给端:HBM 加速迭代,三大原厂开启扩产潮

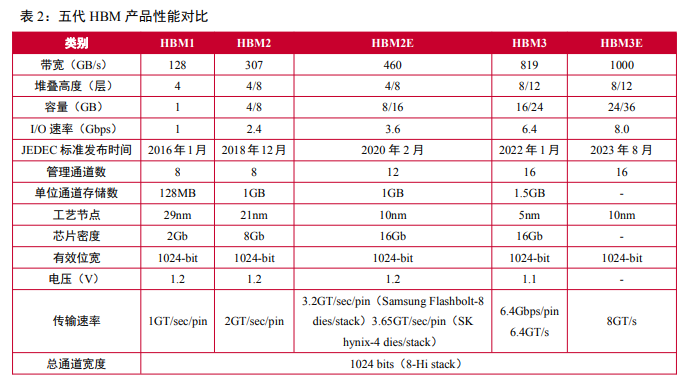

HBM 市场竞争激烈,HBM 产品向低能耗、高带宽、高容量加速迭代。从2016 年第一代HBM1发布开始,HBM 目前已经迭代到第五代产品——HBM3e,纵观五代 HBM 产品性能变化,可以发现HBM在带宽、I/O 速率、容量、工艺节点等方面取得较大突破,其中带宽由初代的 128GB/s 迭代至HBM3e 的1TB/s,I/O 速率由 1Gbps 迭代至 8Gbps,容量从 1GB 增至最高 36GB,制造工艺则取得进一步突破,达到5nm级别。最新一代 HBM3e 数据处理速度最高可达到 1.15TB/s,HBM 系列产品的更新迭代将在低能耗、高带宽、高容量上持续发力,以高性能牵引 AI 技术进一步革新。

三、市场预期

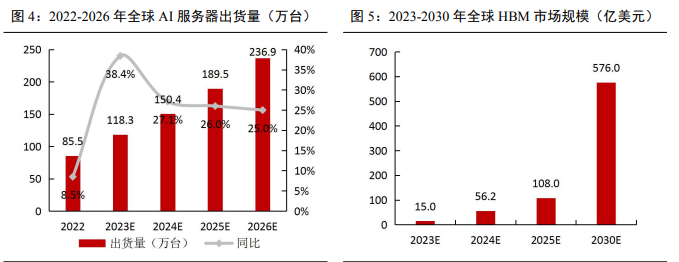

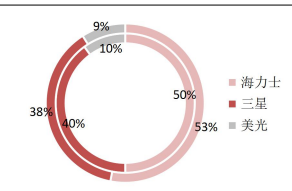

大算力驱动 AI 服务器出货量迅猛增长,叠加 GPU 搭载 HBM 数量提升和HBM容量、价值增长,带来 HBM 市场数百亿美金的增量空间。根据 TrendForce 数据,全球 AI 服务器出货量预期从2022年的85.5万台增至 2026 年的 236.9 万台,CAGR 达 29%。AI 服务器出货量迅猛增长,同时GPU基板搭载HBM数量从 4 颗增至 6 颗,单个 HBM 容量也从 HBM1 的 1GB 提升至 HBM3 的 24GB,HBM价值也随着产品迭代升级而增长,量价驱动下,全球 HBM 市场规模有望从 2023 年的 15 亿美元增至2030 年的576 亿美元,对应 2023-2030 年的年复合增长率达 68.3%

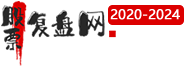

四、市场近两年格局(2022年内圈,2023E外圈)

VIP复盘网

VIP复盘网