摘要

近期市场情绪持续受关税不确定性扰动,避险情绪上升造成算力板块出现较大波动,但AI行业的创新却悄然进入爆发期。我们认为,从需求侧看国内大模型军备竞赛仍在持续中,云厂商Capex仍侧重AI,算力内需并不会因为关税减弱。同时本周四台积电业绩说明会中发布指引与1月设定的目标完全一致,再次验证AI叙事并未发生改变,算力刚性需求仍存在,本周新易盛将公布一季报,可重点关注。

【景气度验证:算力内需与台积电财报的启示】

国内算力需求增长仍持续,AI商业模式闭环速度加速中。从国内算力需求看,Deep Seek对算力效率的改进提升AI行业景气度的逻辑并未发生改变:头部互联网厂商如阿里巴巴、字节跳动等增加Capex并向AI基础设施倾斜,建设更大规模的算力集群以保持领先地位;中小企业利用更低成本的AI大模型实现降本增效;运营商和IDC厂商为企业提供算力支持。我们认为,AI叙事并未改变,仍向技术突破、需求爆发的方向前进,AI算力产业链景气度仍处于上升阶段。

台积电指引率先印证AI产业景气度并未改变。根据周四台积电公布的财报,受AI芯片需求持续激增推动,公司2025年第一季度业绩再超市场预期。同时公司在业绩说明会上表示维持其2025年的营收增长预期,预计今年的增长速度仍将达到25%左右,与1月份设定的目标完全一致,其中AI相关的营收规模预计将翻番。同时公司表示未观察到客户行为因美国关税而发生任何变化,计划将CoWoS先进封装产能翻番,主要用于英伟达AI GPU产能。我们认为,台积电最新财报及指引再次验证了AI算力需求的长期韧性,其产能扩张计划进一步强化了算力基建的刚需逻辑,AI产业景气度仍持续。

【避险情绪上升,静待风险释放后】

资金面“高低切”:市场资金体量有限,算力产业链在近三年大幅上涨后,高位担忧情绪在关税不确定性扰动下迅速蔓延,国内市场在此情况下部分资金暂时流向其他防御板块(如转向高股息标的)。我们认为,目前光模块等行业估值已充分包含关税相关风险,关税落地后风险有望释放。叠加接下来各光模块与其他算力产业链相关企业财报落地,绩优股有望率先获得资金青睐。光模块等行业需求高增情况下,有望出现龙头领衔修复估值、二三线企业紧随其后的情况。

我们认为,目前AI应用已处于突破阶段,多模态、Agent等驱动下需求上扬、产业景气度高涨迅速进行,短期来看,持仓比例的暂时性下调有避险需要。但长期来看,只要AI叙事逻辑未发生根本性动摇,产业发展仍会按照规律持续进行,由此带来的光模块行业景气度终将回归,应重视回调机会。

综上,我们继续看好国产算力产业链,坚定推荐算力板块以及军工通信。推荐军工通信组合:佳讯飞鸿、中国通号、中国卫通、海格通信、七一二等;光模块行业龙头中际旭创、新易盛、天孚通信等,同时建议关注受关税影响跌幅较大,但具有新增量逻辑的公司如威腾电气(母线)等。

建议关注:

算力——

光通信:中际旭创、新易盛、天孚通信、太辰光、腾景科技、光库科技、光迅科技、德科立、联特科技、华工科技、源杰科技、剑桥科技、铭普光磁。铜链接:沃尔核材、精达股份。算力设备:中兴通讯、紫光股份、锐捷网络、盛科通信、菲菱科思、工业富联、沪电股份、寒武纪、海光信息。液冷:英维克、申菱环境、高澜股份。边缘算力承载平台:美格智能、广和通、移远通信。卫星通信:中国卫通、中国卫星、震有科技、海格通信。IDC:润泽科技、光环新网、奥飞数据、科华数据、润建股份。

数据要素——

运营商:中国电信、中国移动、中国联通。数据可视化:浩瀚深度、恒为科技、中新赛克。

风险提示:AI发展不及预期,算力需求不及预期,市场竞争风险。

1. 投资策略:情绪有波动,AI仍向前

本周建议关注:

算力——

光通信:中际旭创、新易盛、天孚通信、太辰光、腾景科技、光库科技、光迅科技、德科立、联特科技、华工科技、源杰科技、剑桥科技、铭普光磁。

铜链接:沃尔核材、精达股份。

算力设备:中兴通讯、紫光股份、锐捷网络、盛科通信、菲菱科思、工业富联、沪电股份、寒武纪。

液冷:英维克、申菱环境、高澜股份。

边缘算力承载平台:美格智能、广和通、移远通信。

卫星通信:中国卫通、中国卫星、震有科技、华力创通、电科芯片、海格通信。

IDC:润泽科技、光环新网、奥飞数据、科华数据、润建股份。

数据要素——

运营商:中国电信、中国移动、中国联通。

数据可视化:浩瀚深度、恒为科技、中新赛克。

本周观点变化:

本周海外算力板块受关税政策不确定性影响仍有较大波动,Meta、亚马逊、微软、谷歌、特斯拉本周分别跌7.7%、6.6%、5.3%、3.8%、4.3%;同时叠加H20系列被列入向中国的出口管制,英伟达跌幅进一步扩大,周跌幅达8.5%。国内方面,算力板块波动较小,跌幅并未较上周进一步扩大。主要由于关税风险已充分price in,中际旭创、新易盛本周涨幅分别为1%、0.2%,天孚通信跌1%。

我们继续看好国产算力产业链,坚定推荐算力板块以及军工通信。推荐军工通信组合:佳讯飞鸿、中国通号、中国卫通、海格通信、七一二等;光模块行业龙头中际旭创、新易盛、天孚通信等,同时建议关注受关税影响跌幅较大,但具有新增量逻辑的公司如威腾电气(母线)等。

2. 行情回顾:通信板块上涨,运营商表现最优

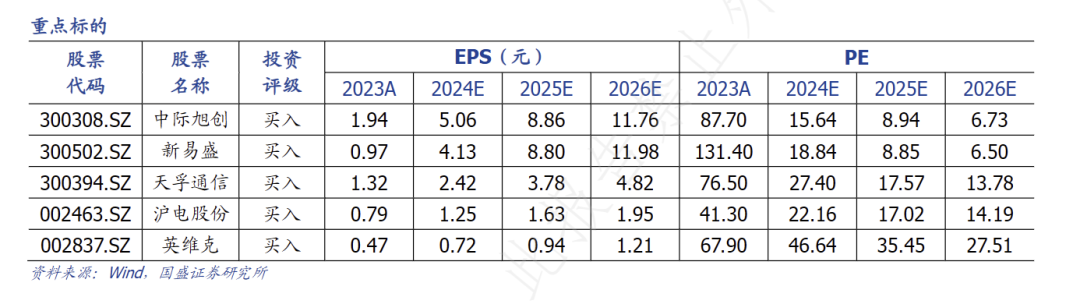

本周(2025年4月14日-2025年4月18日)上证综指收于3276.73点。各行情指标从好到坏依次为:上证综指>沪深300>万得全A >中小板综> 万得全A(除金融,石油石化)> 创业板综。通信板块上涨,表现劣于上证综指。

从细分行业指数看,运营商、移动互联、通信设备、量子通信分别上涨4.1%、3.2%、2.3%、1.9%,表现优于通信行业平均水平;光通信、云计算分别上涨0.5%、0.2%,表现劣于通信行业平均水平;区块链、物联网、卫星通信导航分别下跌0.9%、1.4%、3.5%。

本周受益于6G概念,硕贝德上涨21.360%,领涨版块。受益于通信服务概念,ST龙宇上涨15.612%;受益于车联网概念,拓维信息上涨12.313%;受益于6G概念,海能达上涨12.107%;受益于5G概念,ST中嘉上涨10.924%。

3.周专题:情绪有波动,AI仍向前

近期市场情绪持续受关税不确定性扰动,避险情绪上升造成算力板块出现较大波动,但AI行业的创新却悄然进入爆发期。我们认为,从需求侧看国内大模型军备竞赛仍在持续中,云厂商Capex仍侧重AI,算力内需并不会因为关税减弱。同时本周四台积电业绩说明会中发布指引与1月设定的目标完全一致,再次验证AI叙事并未发生改变,算力刚性需求仍存在,本周新易盛将公布一季报,可重点关注。

【景气度验证:算力内需与台积电财报的启示】

国内算力需求增长仍持续,AI商业模式闭环速度加速中。从国内算力需求看,Deep Seek对算力效率的改进提升AI行业景气度的逻辑并未发生改变:头部互联网厂商如阿里巴巴、字节跳动等增加Capex并向AI基础设施倾斜,建设更大规模的算力集群以保持领先地位;中小企业利用更低成本的AI大模型实现降本增效;运营商和IDC厂商为企业提供算力支持。我们认为,AI叙事并未改变,仍向技术突破、需求爆发的方向前进,AI算力产业链景气度仍处于上升阶段。

台积电指引率先印证AI产业景气度并未改变。根据周四台积电公布的财报,受AI芯片需求持续激增推动,公司2025年第一季度业绩再超市场预期。同时公司在业绩说明会上表示维持其2025年的营收增长预期,预计今年的增长速度仍将达到25%左右,与1月份设定的目标完全一致,其中AI相关的营收规模预计将翻番。同时公司表示未观察到客户行为因美国关税而发生任何变化,计划将CoWoS先进封装产能翻番,主要用于英伟达AI GPU产能。我们认为,台积电最新财报及指引再次验证了AI算力需求的长期韧性,其产能扩张计划进一步强化了算力基建的刚需逻辑,AI产业景气度仍持续。

【避险情绪上升,静待风险释放后】

资金面“高低切”:市场资金体量有限,算力产业链在近三年大幅上涨后,高位担忧情绪在关税不确定性扰动下迅速蔓延,国内市场在此情况下部分资金暂时流向其他防御板块(如转向高股息标的)。我们认为,目前光模块等行业估值已充分包含关税相关风险,关税落地后风险有望释放。叠加接下来各光模块与其他算力产业链相关企业财报落地,绩优股有望率先获得资金青睐。光模块等行业需求高增情况下,有望出现龙头领衔修复估值、二三线企业紧随其后的情况。

我们认为,目前AI应用已处于突破阶段,多模态、Agent等驱动下需求上扬、产业景气度高涨迅速进行,短期来看,持仓比例的暂时性下调有避险需要。但长期来看,只要AI叙事逻辑未发生根本性动摇,产业发展仍会按照规律持续进行,由此带来的光模块行业景气度终将回归,应重视回调机会。

综上,我们继续看好国产算力产业链,坚定推荐算力板块以及军工通信。推荐军工通信组合:佳讯飞鸿、中国通号、中国卫通、海格通信、七一二等;光模块行业龙头中际旭创、新易盛、天孚通信等,同时建议关注受关税影响跌幅较大,但具有新增量逻辑的公司如威腾电气(母线)等。

4. OpenAI重磅发布o3/o4-mini:史上最强、最智能模型

据C114报道,4月17日OpenAI新款AI模型o3、o4-mini重磅发布,这是OpenAI迄今最强、最智能的模型。

据了解,OpenAI o3/o4-mini首次具备真正的视觉推理能力,看图识图已经是小菜一碟了,现在还会看图思考。OpenAI o3/o4-mini能同时处理文本、图像和音频,并且能作为Agent智能体自动调用网络搜索、图像生成、代码解析等工具以及深度思考模式。

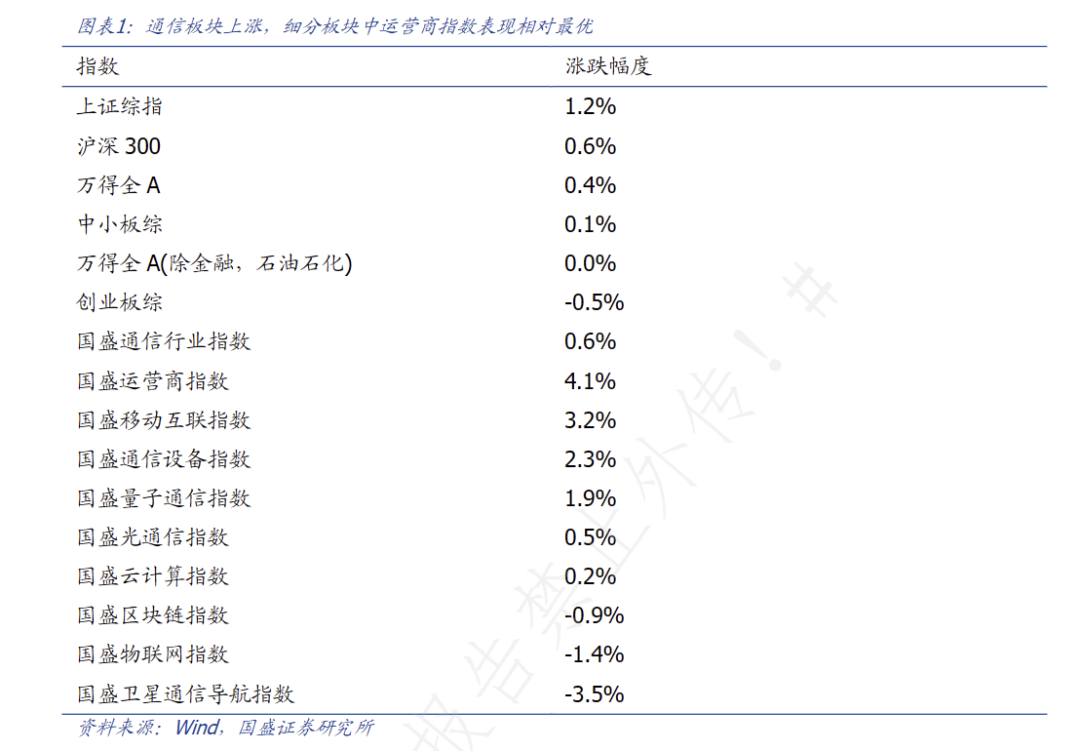

通过强化学习,OpenAI训练了o3/o4-mini如何使用工具,不仅知道如何用、何时用,还能以正确格式快速生成可靠答案。测试结果显示,o3和o4-mini(无工具版本)在AIME 2024数学竞赛题目中的准确率分别达91.6%和93.4%,远超前代o1的74.3%。

在AIME 2025题目中,两者准确率分别达88.9%和92.7%,在Codeforces编程竞赛评分中,支持终端工具的o3和o4-mini分别取得了2706和2719的ELO分数,领先o1的1891和o3-mini的2073。

5. 中国移动发布“万象耕耘”农业大模型

C114报道,4月18日,在河南兰考举办的“央企消费帮扶聚力行动”启动仪式上,中国移动发布自主研发的“万象耕耘”农业大模型。该模型基于中国移动九天人工智能基座,通过多源数据微调构建起“云端大脑 田间神经”的智能体系,标志着农业数字化进程迈入智能决策新阶段。

“万象耕耘”农业大模型以中国移动九天大模型为底座,通过集成多种农业典型场景的AI专业模型,进行协同运算与深度分析,为农业生产提供专业级、科学化的辅助决策建议,为高标准农田平台深度赋能。据介绍,大模型具备五大核心能力:一是农技知识问答能力,大模型搭建“田间百科”,整合了超4千万条农业专业知识,实现3秒生成专业级的解答方案,让农户“听得懂、用得上”;二是农情智能预警能力,通过多源数据构建防灾护盾,通过卫星遥感与物联网传感器融合,实现农情灾害早发现,早预警,早处置;三是农田智慧灌溉能力,依托土壤墒情监测与气象预警联动,对机井和灌溉设备进行智能管控,提升肥料利用率和节水效率,建立“节水-增产”双效机制;四是农作物长势监测能力,运用卫星遥感 无人机巡田,可提前预测产量波动,为生产决策提供建议;五是农事智能规划能力,结合田块信息,利用AI工具对耕、种、管、收各环节农事作业进行指导。“万象耕耘”农业大模型“以用为主,为用而建”,AI农技问答、农情灾害预警、智慧灌溉等能力在兰考高标准农田已示范应用,成为数智赋能农业的重要工具。

6.字节 Seed 开源 UI-TARS-1.5:基于视觉-语言模型构建的多模态智能体

据C114报道,UI-TARS-1.5 昨日正式发布并开源。这是一款基于视觉-语言模型构建的开源多模态智能体,能够在虚拟世界中高效执行各类任务。

UI-TARS-1.5 基于字节此前提出的原生智能体方案 UI-TARS,通过强化学习进一步增强了模型的高阶推理能力,使模型能够在“行动”前先进行“思考”。

该版本的模型中,团队还展示了一个新的愿景:以游戏为载体来增强基础模型的推理能力。与数学、编程等领域相比,游戏更多依赖直观的、常识性的推理,并较少依赖专业知识,因此,游戏通常是评估和提升未来模型通用能力的理想测试场景。

据介绍,UI-TARS 是一个原生 GUI 智能体,具备真实操作电脑和手机系统的能力,同时,还可操控浏览器、完成复杂交互任务。UI-TARS-1.5 能够实现精准 GUI 操作,基于团队在四个维度的技术探索:

视觉感知增强:依托大规模界面截图数据,模型可理解元素的语义与上下文,形成精准描述。

System 2 推理机制:在动作前生成“思维(thought)”,支持复杂任务的多步规划与决策。

统一动作建模:构建跨平台标准动作空间,通过真实轨迹学习提升动作可控性与执行精度。

可自我演化的训练范式:通过自动化的交互轨迹采集与反思式训练,模型持续从错误中改进,适应复杂环境变化。

7. JetBrains 推出 Junie AI 智能体,可驾驭编写代码和调试运行等多步骤任务

C114报道,JetBrains 4月16日发布公告,宣布其 Junie AI 编码智能体已进入“生产就绪”(production-ready)状态,能处理编写代码和调试运行等多步骤任务。

JetBrains 同时还更新了旧版 AI Assistant,支持接入 Anthropic Claude 3.7 Sonnet 和 Google Gemini 2.5 Pro 等新模型,并新增聊天界面多文件编辑功能。

Junie AI 仅支持 IntelliJ IDEA Ultimate、PyCharm Pro、WebStorm 和 GoLand 等 IDE,未来将扩展至 PhpStorm、RubyMine 和 RustRover,但对 Rider(C# IDE)、CLion(C / C )和 Fleet(下一代 IDE)暂无计划。

面对 Microsoft Visual Studio Code 与 GitHub Copilot 的紧密整合,以及 Cursor 和 Windsurf 等 AI 驱动 IDE 的竞争,JetBrains 在 2025.1 IDEs 中推出免费套餐,提供无限代码补全和本地 AI 功能,并附带少量云端信用额度。

对于不愿将代码上传云端的开发者,新版支持 Ollama 或 LM Studio 等离线运行。但需注意,本地代码补全在 IntelliJ IDEA Community Edition 和 PyCharm 免费版中不可用。

8.Claude Research 功能上线:AI 驾驭复杂任务,打造工作神器

C114报道,Anthropic 4月15日发布博文,宣布为其 Claude 推出“Research”功能,并支持 Google Workspace 集成。

Claude 的 Research 功能类似 ChatGPT 的 Deep Research,官方表示将彻底改变信息获取和推理的方式。该功能可以主动进行多轮搜索,逐步深入问题,自动探索不同角度,并系统化解决开放性问题。

用户可获得全面且高质量的答案,附带易于核查的引用信息,确保结果可信。Research 兼顾速度与质量,能在几分钟内完成复杂研究任务,适合日常工作中频繁的信息查询需求。

Claude 现已整合 Gmail、Calendar,最新整合 Google Docs,更贴合用户工作场景提供生产力支持。用户可要求 Claude 整理上周会议记录、提取后续邮件中的行动项,或搜索相关文档获取额外背景。

9.谷歌 DeepMind 开发 DolphinGemma AI 模型,助力海豚“语言”研究

据C114报道,谷歌旗下的 AI 研究实验室谷歌 DeepMind 宣布,成功开发出一款名为 DolphinGemma 的 AI 模型,旨在助力科学家深入研究海豚的“语言”,更好地理解海豚的沟通方式。

DolphinGemma 是基于谷歌开放的 Gemma 系列模型构建的,其训练数据来源于专注于研究大西洋斑点海豚及其行为的非营利组织 Wild Dolphin Project(WDP)。该模型能够生成类似海豚的声音序列,并且非常高效,谷歌表示其可以在手机上运行。

今年夏天,WDP 计划借助谷歌的 Pixel 9 智能手机搭建一个平台,该平台能够合成海豚的声音,并且可以聆听海豚的发声以获得匹配的“回应”。谷歌透露,WDP 此前一直使用 Pixel 6 来进行相关研究工作,而升级到 Pixel 9 后,将使该组织的研究人员能够同时运行 AI 模型和模板匹配算法,从而进一步提升研究效率。

10. LightCounting CEO:3.2T时代,LPO和CPO优势更为明显

据C114报道,对于光模块供应商而言,推动光互联技术持续演进的同时,也关注市场需求动态,灵活调整市场策略。在此背景下,4月17日下午举办的“超大规模智算中心:1.6T时代的全光互联”邀请市场研究机构LightCounting的CEO Dr. Vladimir Kozlov,总结过去20多年的市场历史经验,为未来5年的市场发展提供参考。

Dr. Vladimir Kozlov介绍,从2003年开始,LightCounting直接从光模块厂商那里收集数据,目前几乎每三个月更新一次信息。2024年的数据,由于部分厂商没有完全披露,但市场需求巨大,可以预计2024年以太网光模块的销售将达到100亿美元,同比增长也会接近100%。

这种高增长是否可持续?Dr. Vladimir Kozlov表示,从供应商和他们客户那里得到的数据表示,2025年增长仍将十分强劲,可能会有50%的增长。之后的未来5年内,市场将保持15%-18%区间的较平稳增长。

从细分场景看,云数据中心中使用的以太网光模块占市场的80%,电信和企业市场目前正在开始复苏。云数据中心场景又可以细分为用于AI应用和非AI应用,显然目前用于AI应用的光模块是主角,包括用于Scale-up、Scale-out等网络的构建。

Dr. Vladimir Kozlov介绍,目前光互联需求主要来自于Scale-out网络,Scale-up网络还没有开始使用,不过在不久的将来,无论是LPO/LRO,还是CPO,甚至是xPO(任何其他10米范围的光互联解决方案,具有低功耗、高带宽、高密度的扩展)都将用于构建Scale-up网络。

为什么需要如此高的密度和带宽来扩展网络?如果你想建立一个256卡GPU的系统,使其互联大约需要1152个800G光模块。到了Rubin架构下,扩展到288卡GPU,大约需要5184个1.6T DR8光模块,在四机架配置中,每个机架需要1300多个接口,这意味着没有足够的空间容纳所有这些设备,更不用说成本和功耗了。Dr. Vladimir Kozlov指出,这也是英伟达发布CPO交换机的重要原因。

这一背景下,预计未来3-5年,市场将会是重定时可插拔光模块、LPO可插拔光模块、CPO的混合体。从数量和销量来看,800G和1.6T时代,重定时可插拔设备仍将是最大的市场,到了3.2T时代,LPO和CPO的优势将更加明显,技术也将更加成熟,同时CPO可能是Scale-up多机架系统的唯一解决方案。

Dr. Vladimir Kozlov表示,这是人工智能硬件和光学技术领域的“寒武纪大爆发”,GPU、TPU和XPU等各种各样的加速器芯片相继涌现,需要各种类型的新型网络架构来实现扩展,LPO、CPO和xPO等各种光交换机和光互联技术不断成熟,为互联提供支撑。

11.OpenAI 上线 Flex 处理模式:API 费用减半,但牺牲响应速度及稳定性

据TechCrunch 4月18日报道,为在与谷歌等生成式 AI 竞争对手的较量中进一步加大投入,OpenAI 宣布推出“Flex 处理模式”新的 API 服务 —— 用户以接受响应速度变慢和“资源偶尔无法分配”为代价,换取更优惠的模型使用价格。

OpenAI 表示,Flex 处理目前已对新近发布的 o3 和 o4-mini 推理模型开放测试,主要面向模型评估、数据扩充、异步处理等优先级较低的“非生产”任务。

采用 Flex 处理,API 费用将直接减半。以 o3 为例,Flex 模式下的费用为每百万输入 tokens 收取 5 美元(现汇率约合 36.5 元人民币,相当于约合 75 万字),每百万输出 tokens 收取 20 美元(现汇率约合 146 元人民币)。

作为参考,标准价格分别为 10 美元和 40 美元。对于 o4-mini,Flex 模式的费用则从每百万输入 tokens 收取 1.10 美元、每百万输出 tokens 收取 4.40 美元,降至每百万输入 tokens 收取 0.55 美元(现汇率约合 4 元人民币)和每百万输出 tokens 收取 2.20 美元(现汇率约合 16.1 元人民币)。

OpenAI 在向客户发送的通知邮件中还表示,按照公司用户的消费层级划分,处于第 1 至第 3 层的开发者必须完成新上线的身份验证流程,方可获取 o3 的访问权限。此外,OpenAI 指出,o3 及其他模型的推理摘要功能和流式 API 服务同样需要完成身份验证后才能启用。

OpenAI 此前强调,身份验证机制的目的是防止用户违反公司制定的使用政策。

12. 风险提示

AI发展不及预期,算力需求不及预期,市场竞争风险

VIP复盘网

VIP复盘网